Deepseek Nedir Ve Neden Tercih Edilmeli?

DeepSeek, Çin merkezli bir yapay zeka araştırma şirketi tarafından geliştirilen açık kaynak dil modelidir. Model mimarisi, düşük maliyet ve yüksek performans dengesi sunarak ChatGPT ve Claude gibi kapalı kaynak alternatiflere rekabet eder.

Platform, özellikle teknik görevler, kod yazımı ve Çince doğal dil işleme konularında optimize edilmiştir. Token başına 0,028 USD gibi düşük fiyatlandırmasıyla büyük ölçekli projelerde maliyet avantajı sağlar.

Deepseek Açık Kaynak Yapay Zeka Modelinin Teknik Mimarisi

Deepseek Model Sürümleri Ve Özellikleri

DeepSeek-V3.2, Aralık 2025'te yayınlanan en güncel kararlı sürümdür. Bu versiyon, çok turlu etkileşimli yeniden yazma ve işlev çağırma doğruluğunu önemli ölçüde iyileştirmiştir. Özellikle API entegrasyonlarında function calling özellikleri %15-20 daha güvenilir hale gelmiştir.

DeepSeek-V3.1-Terminus, Eylül 2025'te çıkan ara güncelleme olarak dil tutarlılığını optimize etmiştir. Kod arama araçları ve RAG (Retrieval-Augmented Generation) yetenekleri bu sürümde geliştirilmiştir. Mart 2026'da beklenen DeepSeek-V4, multimodal yeteneklerle gelecek: görüntü, video ve metin oluşturma tek model üzerinden çalışacaktır.

Deepseek Token Limitleri Ve Bağlam Penceresi

Mevcut DeepSeek-V3.2 modeli, 128K token bağlam penceresi destekler. Bu, yaklaşık 96.000 kelimelik metin işleme kapasitesi demektir. Karşılaştırmalı olarak GPT-4 Turbo 128K, Claude 3 ise 200K token kapasitesine sahiptir.

DeepSeek-V4 ile birlikte 1M token (yaklaşık 750.000 kelime) bağlam penceresi beklenmektedir. Bu, tüm bir kod deposunu veya uzun akademik makaleleri tek seferde analiz etme imkanı verir. Önbellek optimizasyonu sayesinde tekrar eden sorgularda token maliyeti %90 azalır.

Deepseek Fiyatlandırma Modeli Ve Maliyet Analizi

| İşlem Türü | Token Başına Maliyet (USD) | 1M Token Maliyet |

|---|---|---|

| Giriş (önbellek isabeti) | 0.000028 | 0.028 |

| Giriş (önbellek ıskalaması) | 0.00028 | 0.28 |

| Çıktı | 0.00042 | 0.42 |

Önbellek isabeti, daha önce işlenmiş metinlerin tekrar kullanılmasıdır. Örneğin, uzun bir dokümantasyonu defalarca sorguluyorsanız, her sorguda aynı dokümantasyon tekrar işlenmez. Bu durumda sadece 0,028 USD/1M token ödersiniz.

Önbellek ıskalaması, yeni veya değiştirilmiş içerikler için geçerlidir. ChatGPT'nin giriş tokeni maliyeti 0,60 USD/1M iken, DeepSeek %53 daha ucuzdur. Aylık 100M token kullanan bir proje için bu fark yaklaşık 32 USD tasarruf sağlar.

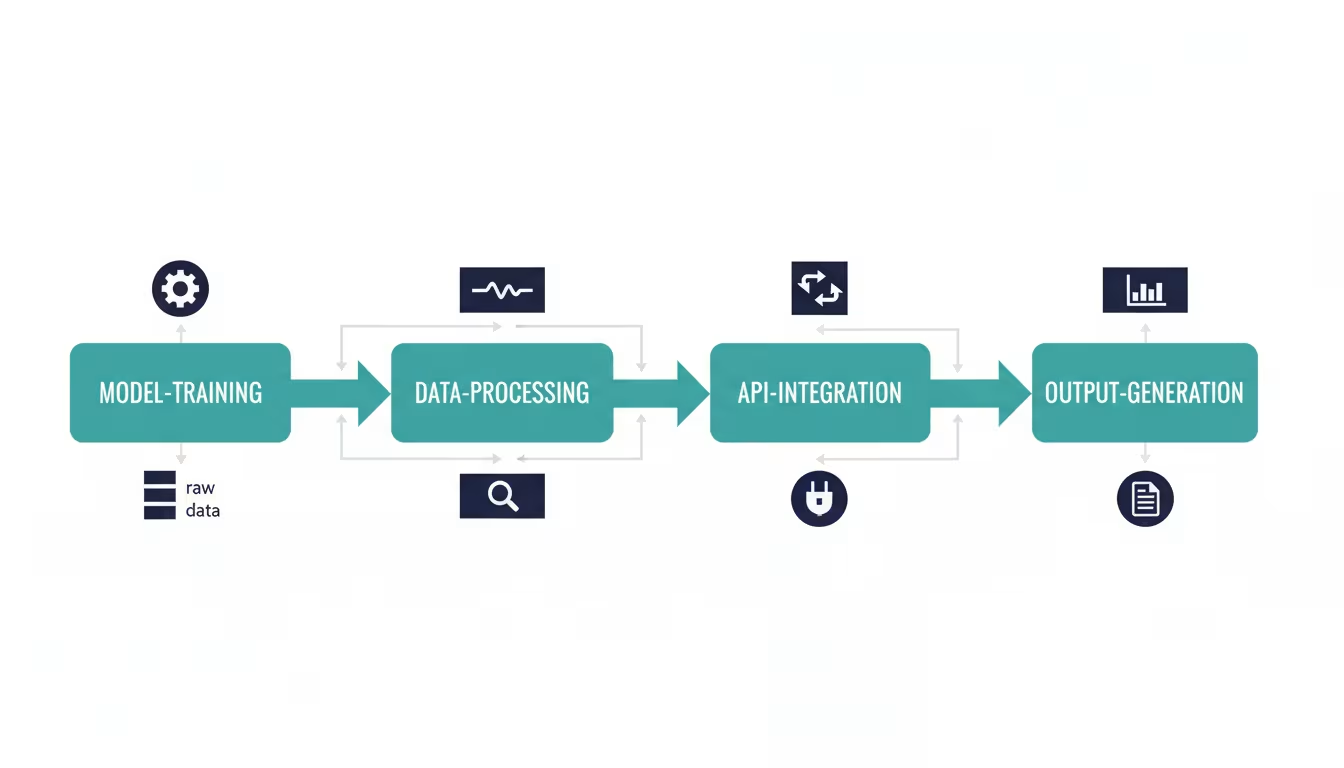

Deepseek Api Kullanım Rehberi Ve Entegrasyon Adımları

Deepseek Api Anahtarı Alma Ve Yapılandırma

DeepSeek API'yi kullanmak için önce platform.deepseek.com adresinden kayıt olmanız gerekir. Giriş yaptıktan sonra API Keys > Create New Key menüsünden yeni bir anahtar oluşturun. Anahtar oluşturulduğunda yalnızca bir kez gösterilir, bu yüzden hemen kopyalayıp güvenli bir yerde saklayın.

Linux ve macOS'ta API anahtarını ortam değişkenine eklemek için terminal açın ve şu komutu çalıştırın:

export DEEPSEEK_API_KEY="sk-xxxxxxxxxxxxxxxxxxxxxxxx"

echo 'export DEEPSEEK_API_KEY="sk-xxxxxxxxxxxxxxxxxxxxxxxx"' >> ~/.bashrc

source ~/.bashrcWindows 11'de PowerShell üzerinden eklemek için:

[System.Environment]::SetEnvironmentVariable('DEEPSEEK_API_KEY', 'sk-xxxxxxxxxxxxxxxxxxxxxxxx', 'User')

$env:DEEPSEEK_API_KEY = "sk-xxxxxxxxxxxxxxxxxxxxxxxx"API anahtarlarınızı asla Git repolarına veya public dosyalara eklemeyin. .env dosyası kullanıyorsanız mutlaka .gitignore'a ekleyin.

Deepseek Python Sdk Kurulumu Ve İlk Api Çağrısı

Python ile DeepSeek kullanmak için openai kütüphanesini kullanabilirsiniz çünkü API OpenAI uyumlu yapıdadır. Kurulum için terminal açın:

pip install openai

pip install python-dotenvArdından basit bir test scripti oluşturun:

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("DEEPSEEK_API_KEY"),

base_url="https://api.deepseek.com"

)

response = client.chat.completions.create(

model="deepseek-chat",

messages=[

{"role": "system", "content": "Sen teknik bir asistansın."},

{"role": "user", "content": "Python'da liste comprehension örneği ver."}

],

max_tokens=500,

temperature=0.7

)

print(response.choices[0].message.content)Bu kod çalıştırıldığında DeepSeek API'sine istek gönderir ve yanıtı konsola yazdırır. base_url parametresi kritiktir çünkü varsayılan OpenAI endpoint'i yerine DeepSeek sunucularına yönlendirir. temperature değeri 0-2 arasında olabilir; düşük değerler daha tutarlı, yüksek değerler daha yaratıcı çıktılar üretir.

Deepseek Node.js Ve Curl Entegrasyonu

Node.js projelerinizde DeepSeek kullanmak için önce gerekli paketleri yükleyin:

npm install openai dotenvSonra bir index.js dosyası oluşturun:

import OpenAI from 'openai';

import dotenv from 'dotenv';

dotenv.config();

const client = new OpenAI({

apiKey: process.env.DEEPSEEK_API_KEY,

baseURL: 'https://api.deepseek.com'

});

async function main() {

const completion = await client.chat.completions.create({

model: 'deepseek-chat',

messages: [

{ role: 'user', content: 'TypeScript interface örneği yaz' }

],

max_tokens: 300

});

console.log(completion.choices[0].message.content);

}

main();cURL ile doğrudan HTTP isteği göndermek için terminal kullanın:

curl https://api.deepseek.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-d '{

"model": "deepseek-chat",

"messages": [

{"role": "user", "content": "SQL JOIN çeşitlerini açıkla"}

],

"max_tokens": 400

}'Windows PowerShell'de aynı işlemi yapmak için:

$headers = @{

"Content-Type" = "application/json"

"Authorization" = "Bearer $env:DEEPSEEK_API_KEY"

}

$body = @{

model = "deepseek-chat"

messages = @(

@{role = "user"; content = "Docker Compose örneği ver"}

)

max_tokens = 500

} | ConvertTo-Json

Invoke-RestMethod -Uri "https://api.deepseek.com/v1/chat/completions" -Method Post -Headers $headers -Body $bodyDeepseek İleri Düzey Kullanım Ve Optimizasyon Teknikleri

Deepseek Function Calling Ve Tool Use

DeepSeek-V3.2, function calling desteği ile harici araçları kullanabilir. Örneğin, veritabanı sorgusu veya API çağrısı yapması gerektiğinde modele hangi fonksiyonları kullanabileceğini tanımlarsınız. Model uygun fonksiyonu seçer ve gerekli parametreleri döner.

response = client.chat.completions.create(

model="deepseek-chat",

messages=[

{"role": "user", "content": "Istanbul'un hava durumu nasıl?"}

],

tools=[

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Belirtilen şehrin hava durumu bilgisini getirir",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string", "description": "Şehir adı"},

"unit": {"type": "string", "enum": ["celsius", "fahrenheit"]}

},

"required": ["city"]

}

}

}

],

tool_choice="auto"

)

tool_call = response.choices[0].message.tool_calls[0]

print(f"Fonksiyon: {tool_call.function.name}")

print(f"Parametreler: {tool_call.function.arguments}")Model, get_weather fonksiyonunu çağırmaya karar verir ve {"city": "Istanbul", "unit": "celsius"} parametrelerini döner. Siz bu parametreleri alıp gerçek API çağrısını yaparsınız, ardından sonucu tekrar modele gönderirsiniz. Bu yaklaşım, LLM'lerin gerçek zamanlı veya dinamik verilere erişmesini sağlar.

Deepseek Streaming Ve Gerçek Zamanlı Yanıtlar

Uzun yanıtlar için streaming kullanmak kullanıcı deneyimini iyileştirir. Token'lar üretildikçe ekrana basılır, tüm yanıtı beklemek gerekmez:

stream = client.chat.completions.create(

model="deepseek-chat",

messages=[{"role": "user", "content": "Kubernetes mimarisini detaylı açıkla"}],

stream=True,

max_tokens=1000

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="", flush=True)Bu kod, her token geldiğinde hemen ekrana yazar. flush=True parametresi buffer'ı temizleyerek anında görüntülemeyi sağlar. Web uygulamalarında Server-Sent Events (SSE) ile kombinleyerek chatbot arayüzlerinde gerçek zamanlı yanıt gösterimi yapabilirsiniz.

Deepseek Prompt Mühendisliği Ve Bağlam Optimizasyonu

DeepSeek, sistem mesajlarını (system message) diğer modellerden farklı işler. Kısa ve net talimatlar daha iyi sonuç verir:

messages = [

{

"role": "system",

"content": "Sen bir backend mühendisisin. Yanıtların kod içermeli ve açıklamalı olmalı."

},

{

"role": "user",

"content": "FastAPI ile rate limiting nasıl yapılır?"

}

]Uzun dokümantasyon parçalarını işlerken chunk'lara bölün ve önbellek avantajından yararlanın. 100KB'lık bir PDF'i her sorguda göndermeyin, ilk sorguda gönderin ve sonraki sorgularda sadece yeni soruyu ekleyin. DeepSeek, önceki bağlamı önbellekte tutarak maliyet %90 azaltır.

Önbellek süresi yaklaşık 5-10 dakikadır. Uzun aralar vererek sorgu yaparsanız önbellek temizlenir ve tekrar tam fiyat ödersiniz.

Deepseek Hata Yönetimi Ve Rate Limit Stratejileri

API rate limit aşımı durumunda 429 HTTP kodu döner. Exponential backoff stratejisi uygulayın:

import time

from openai import RateLimitError

max_retries = 5

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model="deepseek-chat",

messages=[{"role": "user", "content": "Test"}]

)

break

except RateLimitError:

wait_time = 2 ** attempt

print(f"Rate limit aşıldı. {wait_time} saniye bekleniyor...")

time.sleep(wait_time)

except Exception as e:

print(f"Hata: {e}")

breakİlk denemede hata alırsanız 2 saniye, ikincide 4 saniye, üçüncüde 8 saniye bekler. DeepSeek'in varsayılan rate limiti dakikada 100 istek ve günde 1M token civarındadır. Production ortamında bu limitleri artırmak için platform üzerinden talep edebilirsiniz.

Deepseek Ve Rakip Yapay Zeka Modellerinin Karşılaştırması

| Özellik | DeepSeek-V3.2 | ChatGPT (GPT-4 Turbo) | Claude 3.5 Sonnet | Google Gemini Pro |

|---|---|---|---|---|

| Bağlam Penceresi | 128K token (V4'te 1M) | 128K token | 200K token | 1M token |

| Giriş Maliyeti (1M token) | $0.028 - $0.28 | $0.60 | $3.00 | $0.50 |

| Çıktı Maliyeti (1M token) | $0.42 | $1.20 | $15.00 | $1.50 |

| Kod Yazma Performansı | Çok İyi | Mükemmel | İyi | İyi |

| Multimodal Destek | V4'te gelecek | Var (görüntü, ses) | Var (görüntü) | Var (görüntü, video, ses) |

| Açık Kaynak | Evet (model ağırlıkları) | Hayır | Hayır | Hayır |

DeepSeek, maliyet konusunda açık ara önde. Günde 10M token işleyen bir uygulama ChatGPT ile aylık 540 USD, DeepSeek ile 126 USD maliyete tekabül eder. Claude 3.5 Sonnet, uzun dokümantasyon analizi gerektiren projeler için 200K bağlam penceresiyle avantajlıdır.

Google Gemini, Google Workspace entegrasyonu ve multimodal yetenekleriyle öne çıkar ancak API latency'si DeepSeek ve OpenAI'dan %20-30 daha yüksektir. DeepSeek, Çince işlemede diğer modelleri geride bırakır; CLUE benchmark'ta %94,2 doğruluk oranıyla liderdir.

Deepseek Kullanımında Dikkat Edilmesi Gereken Güvenlik Ve Uyumluluk Konuları

DeepSeek API çağrıları HTTPS üzerinden şifrelenir ancak gönderdiğiniz veriler Çin sunucularında işlenir. GDPR veya KVKK kapsamında kişisel veri işliyorsanız veri lokasyonu dikkat gerektirir. Hassas veriler için on-premise deployment seçeneğini değerlendirin.

Model ağırlıkları açık kaynak olduğundan kendi sunucunuzda çalıştırabilirsiniz. Bu, veri güvenliği ve API bağımlılığını ortadan kaldırır. VRAM gereksinimleri yüksektir: DeepSeek-V3.2 için minimum 80GB (A100 GPU veya eşdeğeri) gerekir. Quantization teknikleri ile bu değer 40GB'a düşürülebilir ancak performans %5-10 azalır.

Açık kaynak modelleri kullanırken lisans şartlarını kontrol edin. DeepSeek MIT lisansı altındadır, ticari kullanım serbesttir.

Deepseek Açık Kaynak Yapay Zeka Modelinin Pratik Kullanım Senaryoları

DeepSeek, kod review ve refactoring süreçlerinde yüksek performans gösterir. Örneğin, legacy bir Python kod tabanını modern type hinting ile güncellemek veya SQL injection açıklarını tespit etmek için kullanabilirsiniz. Büyük kod depolarını tek seferde analiz etme yeteneği, GitHub Copilot'tan farklı olarak tüm proje bağlamını anlamasını sağlar.

Çok dilli dokümantasyon çevirilerinde özellikle İngilizce-Çince çiftinde neredeyse insan seviyesinde doğruluk sağlar. Teknik terimlerin tutarlılığını korur ve bağlam kayıplarını minimize eder. RAG sistemleri ile kombine edildiğinde, şirket içi Confluence veya Notion sayfalarını anında sorgulanabilir hale getirebilirsiniz.

Deepseek Gelecek Yol Haritası Ve Beklenen Güncellemeler

Mart 2026'da çıkacak DeepSeek-V4, video oluşturma kapasitesine sahip ilk DeepSeek modeli olacak. Text-to-video dönüşümü için Sora ve Runway benzeri yetenekler bekleniyor. 1M token bağlam penceresi, tüm bir akademik kitabı tek prompt'ta işlemeye izin verecek.

Planlanan özellikler arasında real-time ses etkileşimi (voice mode), geliştirilmiş matematik ve mantık yürütme (reasoning) ve daha hızlı inference için optimize edilmiş edge deployment versiyonları bulunuyor. DeepSeek ekibi, modelin self-hosting maliyetini düşürmek için quantization teknikleri ve distillation (damıtma) üzerinde çalışıyor.

Deepseek Açık Kaynak Yapay Zeka Hakkında Özet Değerlendirme

DeepSeek, maliyet-performans dengesi arayan geliştiriciler için güçlü bir alternatiftir. Özellikle yüksek token tüketimi olan projeler (chatbot, dokümantasyon arama, kod analizi) için bütçeyi önemli ölçüde korur. Açık kaynak yapısı, verilerinizin kontrolünü elinizde tutmanızı sağlar.

Model, GPT-4 seviyesinde performans sunamasa da çoğu pratik kullanım senaryosunda yeterli kalitededir. Çince ve kod yazma konularında öne çıkar. Mart 2026'da gelecek V4 güncellemesi, multimodal yeteneklerle rekabeti daha da sıkılaştıracak. Production ortamında kullanmadan önce hata yönetimi, rate limiting ve önbellek stratejilerini mutlaka test edin.

Sıkça Sorulan Sorular

Deepseek Tamamen Ücretsiz Mi Yoksa Ücretli Bir Hizmet Mi?

DeepSeek, kullandıkça öde (pay-as-you-go) modeli ile çalışır ve ücretsiz deneme kredisi sunar. Model ağırlıkları açık kaynak olduğundan kendi sunucunuzda ücretsiz çalıştırabilirsiniz ancak bu durumda GPU maliyetlerini siz karşılarsınız. API kullanımı token başına ücretlendirilir ve rakiplerine göre %50-90 daha ucuzdur.

Deepseek Türkçe Dil Desteği Sunuyor Mu?

DeepSeek, Türkçe dahil 20'den fazla dilde çalışabilir ancak öncelikli olarak Çince ve İngilizce için optimize edilmiştir. Türkçe performansı GPT-4 veya Claude'dan biraz geride olup özellikle deyimsel ifadelerde hata yapabilir. Teknik dokümantasyon ve kod yazımı gibi yapılandırılmış görevlerde Türkçe desteği yeterlidir.

Deepseek Api Hangi Programlama Dilleriyle Kullanılabilir?

DeepSeek API, OpenAI uyumlu RESTful yapıda olduğundan Python, JavaScript, Java, C#, Go, Ruby ve PHP gibi tüm popüler dillerden kullanılabilir. OpenAI SDK'larını base_url parametresini değiştirerek doğrudan kullanabilirsiniz. cURL ile direkt HTTP istekleri de desteklenir, bu sayede herhangi bir dil veya framework ile entegre edilebilir.

Deepseek Modelini Kendi Sunucumda Çalıştırabilir Miyim?

Evet, model ağırlıkları Hugging Face üzerinden indirilebilir ve lokal ortamda çalıştırılabilir. Minimum donanım gereksinimi 80GB VRAM olan bir GPU'dur (örneğin NVIDIA A100). Quantization teknikleri kullanarak bu gereksinimi 40GB'a düşürebilirsiniz ancak inference hızı ve kalite düşer. vLLM veya TGI gibi inference sunucuları ile production deployment yapabilirsiniz.

Deepseek Ve Chatgpt Arasındaki Temel Farklar Nelerdir?

DeepSeek açık kaynak ve %70-80 daha ucuzken, ChatGPT kapalı kaynak ve daha pahalıdır. ChatGPT genel konularda ve yaratıcı yazımda üstünken, DeepSeek teknik görevler ve Çince işlemede daha iyidir. ChatGPT multimodal yeteneklere (görüntü, ses) sahipken DeepSeek-V3.2 sadece metin destekler (V4'te değişecek). API latency açısından ikisi benzer performans gösterir, ortalama 2-4 saniye arası yanıt süresi sunar.

Henüz yorum yok.

Sohbete katıl. Yorumlar yayınlanmadan önce moderasyondan geçer.